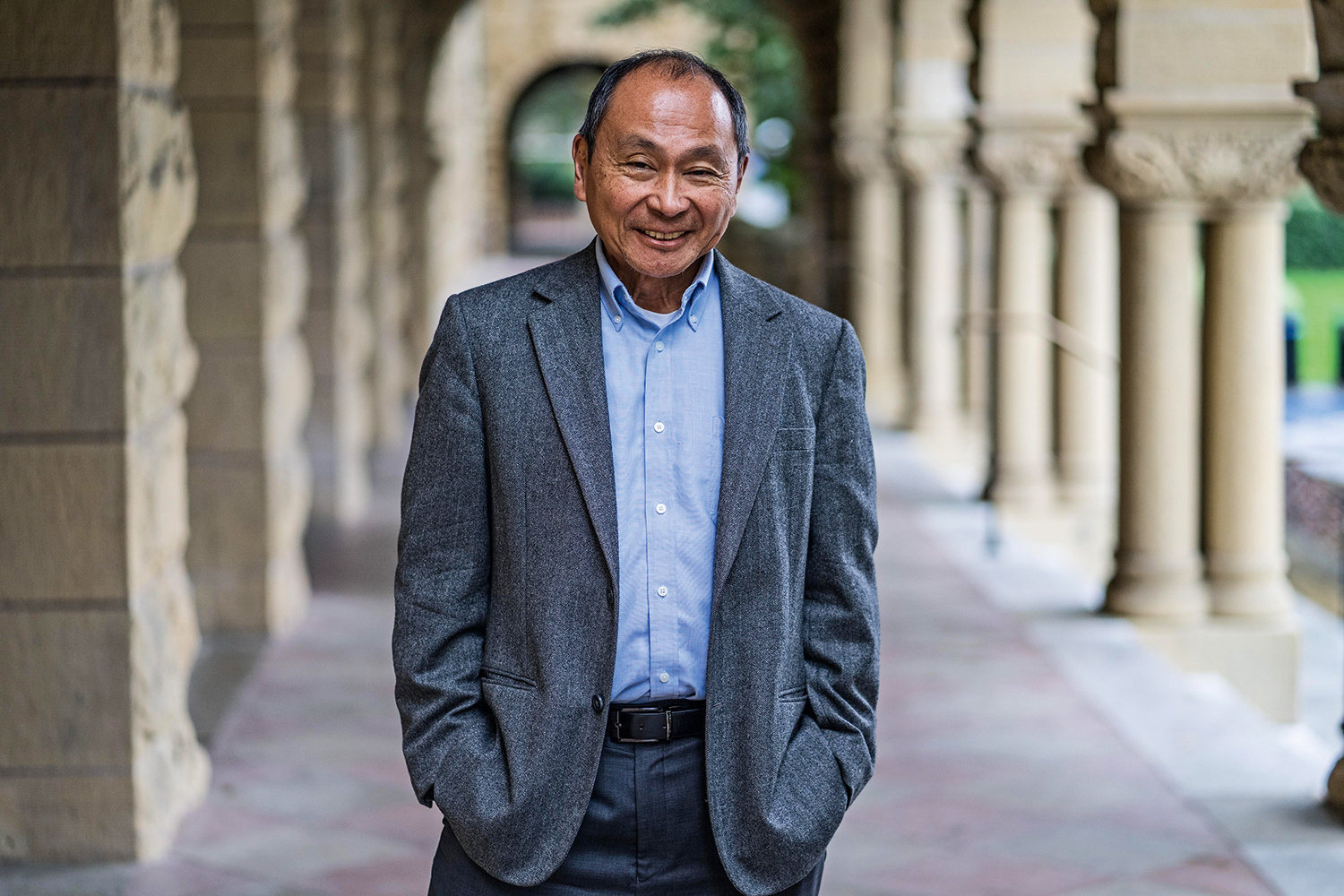

Francis Fukuyama: Tornando a internet segura para a democracia

……………

…………………

Francis Fukuyama é pesquisador sênior e diretor do Centro de Estudos sobre Democracia, Desenvolvimento e Estado de Direito.

Este artigo (publicado originalmente no Journal of Democracy em português, vol. 10, n. 01, de maio de 2021, reflete os achados do Grupo de Trabalho sobre a Escala das Plataformas Digitais da Universidade Stanford e é aqui reproduzido na parceria do Estado da Arte com a Fundação Fernando Henrique Cardoso.

……….

………..

Muitas pessoas passaram a enxergar a internet como uma das grandes ameaças à democracia contemporânea. A internet, e grandes plataformas como Google, Facebook e Twitter em particular, têm sido apontadas como responsáveis pela ascensão de Donald Trump e do populismo que ele representa, pela proliferação de teorias da conspiração e de fake news, e pela intensa polarização política que aflige os Estados Unidos e muitas outras democracias. Em todo o mundo, políticos com inclinações autoritárias, como Rodrigo Duterte nas Filipinas e Narendra Modi na Índia, têm feito um uso efetivo do Facebook e do Twitter para se comunicar com seus seguidores e atacar oponentes.

No entanto, há muita confusão sobre onde reside a verdadeira ameaça à democracia. Essa confusão começa com uma questão de causalidade: as plataformas simplesmente refletem conflitos políticos e sociais existentes, ou são na verdade a causa de tais conflitos? A resposta a essa questão será a chave para encontrarmos os remédios apropriados.

Essa questão atingiu seu ápice após a invasão do Congresso dos Estados Unidos em 6 de janeiro de 2021, instigada pelo presidente Trump nos últimos dias de seu mandato. Na sequência do episódio, o Twitter suspendeu a conta de Trump, tirando o principal canal usado por ele para se comunicar com seus seguidores. Embora muitas pessoas tenham aplaudido essa decisão, e até mesmo condenado o Twitter por ter demorado a fazê-lo, outros demonstraram preocupações com o poder que o Twitter havia acumulado. O presidente Trump foi efetivamente calado nos dias seguintes à suspensão da conta. Os conservadores criticaram imediatamente a manobra — e decisões similares tomadas por Facebook, Google e Amazon pouco tempo depois —, chamando-a de “censura”. E, embora seja possível aprovar a decisão do Twitter como uma resposta de curto prazo ao perigo da incitação de violência, críticos conservadores dessa manobra levantam questões relevantes sobre os perigos relacionados ao poder dessas plataformas.

Juridicamente falando, a acusação de censura não procede. Na legislação americana, a vedação de censura garantida pela Primeira Emenda se aplica apenas a ações do governo. Essa emenda de fato protege o direito de entes privados como o Twitter e o Facebook de publicar o conteúdo que quiserem. Além dessas proteções, plataformas online foram blindadas contra certos tipos de responsabilidade civil pelo artigo 230 da Lei da Decência nas Comunicações de 1996. O problema com o qual nos deparamos atualmente, no entanto, é de escala: essas plataformas são tão grandes que passaram a representar uma “praça pública”, na qual cidadãos debatem problemas e ideias. Há muitas corporações privadas que fazem a curadoria da informação que publicam, entre elas os órgãos de imprensa, como o New York Times ou o Wall Street Journal. Mas nenhuma empresa da mídia tradicional é tão dominante ou alcança tantas pessoas atualmente quanto o Twitter, o Facebook e o Google. A escala dessas plataformas de internet é tão grande que decisões tomadas por seus donos poderiam afetar os resultados de eleições democráticas como nenhum veículo tradicional de imprensa seria capaz.

Outro grande problema com as grandes plataformas de internet diz respeito à transparência. Embora o Twitter tenha anunciado publicamente a suspensão de Donald Trump, tanto o Twitter como o Facebook e o Google tomam literalmente milhares de decisões relacionadas à curadoria de conteúdo todos os dias. Grande parte das decisões de remoção de conteúdo é incontroversa, como aquelas relacionadas à incitação de ataques terroristas, pornografia infantil e conspirações abertamente criminosas. Mas algumas decisões de marcar ou remover posts são controversas ou simplesmente equivocadas, sobretudo a partir do momento em que passaram a depender cada vez mais de sistemas de inteligência artificial (IA) para moderar conteúdo durante a pandemia da Covid-19. Uma questão ainda mais central diz respeito não a que conteúdo as plataformas de redes sociais removem, mas ao conteúdo que decidem exibir. Entre o vasto número de postagens feitas no Twitter ou no Facebook, o conteúdo que de fato aparece em nossos feeds é selecionado por complexos algoritmos de IA desenvolvidos primeiramente não para proteger valores democráticos, mas para maximizar a receita dessas empresas. Não é surpresa, portanto, que essas plataformas estejam sendo acusadas de propagar teorias da conspiração, calúnias e outras formas tóxicas de conteúdo viral: é isso que dá lucro. Os usuários não sabem por que estão vendo o que aparece em seus feeds, ou o que não estão vendo por causa de decisões de um programa de IA invisível.

……………………..

Males

É necessário, portanto, precisarmos a natureza da ameaça que as grandes plataformas representam à democracia liberal moderna. Ela não reside no mero fato de que essas plataformas transmitam “fake news”, teorias da conspiração ou outros tipos de conteúdo político danoso. A Primeira Emenda da Constituição dos Estados Unidos protege o direito de cidadãos de dizer o que quiserem, exceto de promover violência ou sedição. Outras democracias possuem proteções menos absolutas ao direito à liberdade de expressão, mas ainda assim concordam com o princípio subjacente de que deveria haver um mercado aberto de ideias no qual o governo deveria desempenhar um papel limitado.

O verdadeiro problema gira ao redor da capacidade que as plataformas têm de amplificar ou silenciar certas mensagens, e de fazê-lo em uma escala capaz de produzir consequências políticas importantes. Qualquer resposta de política pública não deveria ter como objetivo silenciar conteúdo considerado politicamente prejudicial. A versão de noção de que Donald Trump teria vencido de forma esmagadora as eleições presidenciais de 2020 e que os democratas teriam fraudado aquele resultado é falsa e, ao ser divulgada repetidamente pelo então presidente candidato à reeleição, profundamente prejudicial à democracia americana. Mas também é compartilhada por dezenas de milhões de americanos, e não é nem normativamente aceitável nem praticamente possível impedi-los de expressar suas opiniões a respeito. Para o bem ou para o mal, as pessoas que acreditam nisso precisam ser persuadidas, e não simplesmente caladas.

Em vez disso, o que as políticas públicas devem perseguir é o poder dominante das plataformas tanto de ampliar como de silenciar certas vozes na esfera política. Até o momento, temos confiado em pessoas como o CEO do Twitter, Jack Dorsey, ou o do Facebook, Mark Zuckerberg, para fazer “a coisa certa”, filtrando os conteúdos politicamente prejudiciais. Isso é algo que pode funcionar no curto prazo, quando a nação se depara com uma ameaça iminente de violência política. Mas não é uma solução de longo prazo ao problema subjacente, que é o poder excessivamente concentrado.

Nenhuma democracia deve depender das boas intenções de detentores de poder. Diversas correntes da teoria democrática moderna defendem a ideia de que as instituições políticas precisam limitar o poder arbitrário independentemente de quem o detém. Esse princípio está implícito no conceito desenvolvido por John Rawls de “véu da ignorância”, segundo o qual as regras justas em uma sociedade liberal devem ser desenvolvidas sem conhecimento prévio sobre a quais pessoas elas se aplicam. A constituição de 1780 do estado de Massachusetts, escrita por John Adams, Samuel Adams e James Bowdoin, dizia que “o Executivo não deve exercer poderes legislativos ou judiciários […] para que tenhamos um governo das leis e não dos homens”. O famoso artigo n.º 51 de James Madison em Os artigos federalistas lança as bases para um sistema de poderes divididos, argumentando que “ao moldar um governo que deve ser exercido por homens sobre homens, a grande dificuldade reside nisto: é preciso primeiro capacitar o governo a controlar os governados; e em seguida obrigá-lo a controlar a si próprio”. A única solução prática para esse problema foi inserir “na sociedade um número tão grande de categorias distintas de cidadãos que tornaria muito improvável, se não impraticável, o conluio injusto de uma maioria”. Em outras palavras, o poder só poderia ser controlado se fosse dividido, por meio de um sistema de freios e contrapesos.

Os autores desses comentários visavam o poder do Estado, mas suas preocupações sem dúvida se aplicam também à concentração de poder privado, que não está sujeito aos mecanismos de controle comparáveis a eleições populares. O poder privado só pode ser controlado pelo governo (por meio de regulação) ou pela competição entre os detentores de poder. Nos Estados Unidos, devido a uma tradição de desconfiança do poder do Estado, a competição de mercado é normalmente vista como um meio preferencial de controlar e limitar o poder privado. O medo das consequências sociais e políticas do poder de monopólio, entre outras preocupações, inspiraram a passagem de leis que compõem a espinha dorsal da legislação antitruste norte-americana — a Lei Sherman (1890), a Lei Clayton (1914) e a Lei da Comissão Federal de Comércio (1914).

………………

Remédios

Como podemos reduzir o poder inerente às plataformas de internet? Acredito que uma possível solução para esse problema seja o uso tanto de tecnologia como de regulação para delegar a curadoria de conteúdo das plataformas dominantes a uma camada competitiva de “empresas intermediárias” (middleware). Defendo essa proposta não porque estou seguro de que vá funcionar, mas porque as abordagens alternativas que têm sido sugeridas possivelmente sejam menos efetivas.

A primeira e mais óbvia dessas abordagens é usar a lei antitruste para dividir o Facebook e o Google, assim como foi feito com a gigante AT&T nos anos 1970. Após um longo período de aplicação branda das leis antitruste, há um crescente consenso de que é preciso aplicá-las às grandes empresas de tecnologia, e ações foram movidas contra essas plataformas pela Comissão Europeia, órgão executivo da União Europeia, e, nos Estados Unidos, pelo Departamento de Justiça, pela Comissão Federal de Comércio e por uma coalizão de procuradores-gerais.

Dividir essas empresas de fato reduziria seu poder sobre a política. Mas sob as atuais leis europeias e norte-americanas, chegar a essa decisão nos tribunais poderia levar décadas, como foi nos casos movidos contra a IBM e a Microsoft. Mais importante, externalidades de rede sugerem que um Facebook diminuído que emergiria dessa divisão poderia crescer muito mais rapidamente do que a AT&T quando foi dividida, e rapidamente alcançar o tamanho de seu predecessor. De todo modo, a legislação antitruste foi projetada primeiramente para remediar os conhecidos danos decorrentes da concentração de poder econômico, não os novos riscos políticos produzidos pelas redes sociais. O que poderá realisticamente resultar das atuais iniciativas antitruste são restrições à aquisição de startups pelas plataformas ou à prática de “venda casada” (políticas que compelem usuários de um produto oferecido por uma das gigantes de tecnologia a adquirir um serviço relacionado da mesma empresa). Mas consequências dessa natureza não enfrentam os problemas políticos causados pela escala das plataformas.

Um segundo remédio óbvio é a regulação estatal, algo que tanto a União Europeia como seus países-membros individualmente vêm tentando colocar em prática. A Lei de Fiscalização da Rede (Neztdurchsetzungsgesetz, ou “NetzDG”) da Alemanha, por exemplo, impõe multas pesadas a empresas que não removam conteúdo considerado ilegal no país em até um dia após ter sido denunciado. Há precedentes nos Estados Unidos para a regulação estatal do conteúdo distribuído pelas principais plataformas de mídia. Nos anos 1960, quando as redes de televisão detinham um controle oligopolista da discussão política similar à crescente dominância das atuais plataformas de redes sociais, a Comissão Federal de Comunicações (FCC) usou seu poder de conceder licenças para aplicar a Doutrina da Equidade, que exigia que grandes veículos de imprensa apresentassem pontos de vista divergentes sobre um tema. A constitucionalidade da Doutrina da Equidade foi mantida por uma decisão da Suprema Corte de 1969 no caso Red Lion Broadcasting Co. vs. FCC, mas foi implacavelmente atacada depois disso por republicanos que consideravam que a FCC tinha um viés contra conservadores. A Doutrina da Equidade foi anulada em 1987 por meio de uma decisão administrativa da FCC, e os democratas fracassaram em suas tentativas de restaurá-la. Embora algumas democracias europeias disponham de consenso social suficiente para perseguir a regulação de conteúdo, os Estados Unidos atualmente estão polarizados demais para conseguirem autorizar a FCC ou qualquer outro órgão de governo a determinar o que seja um conteúdo “justo e equilibrado” e aplicar o princípio às plataformas de internet. A regulação, portanto, parece ser um beco sem saída nos Estados Unidos no presente momento.

Uma terceira abordagem que tem sido aplicada para reduzir o poder das plataformas é a portabilidade dos dados dos usuários. A ideia é que os usuários individuais são os proprietários de seus dados e devem ser capazes de transferi-los a outras plataformas, assim como podem transferir seu número de celular de uma operadora a outra. Embora essa abordagem pareça uma maneira interessante de aumentar a competição entre as plataformas, ela enfrenta dificuldades envolvendo tanto direitos de propriedade como viabilidade técnica. Para as finalidades das plataformas, os dados mais importantes que possuem não são os dados pessoais voluntariamente fornecidos pelos usuários, mas as montanhas de metadados criadas a partir da interação entre os usuários nessas plataformas. Não está claro juridicamente falando a quem pertencem os metadados, e as plataformas lutarão para manter o controle sobre tais dados, que são a base de seus modelos de negócio. Além disso, esses dados são imensamente heterogêneos e específicos a cada plataforma. A portabilidade de dados não é, portanto, uma maneira de enfrentar a ameaça política representada pelo poder das plataformas.

Por fim, algumas pessoas sugeriram que o poder das plataformas pode ser controlado aplicando leis de privacidade para impedir que elas usem os dados coletados em uma esfera, como por exemplo a venda de livros, em outra, como a venda de alimentos ou de fraldas (algo que a Amazon faz), sem o consentimento explícito dos usuários. Tais restrições já fazem parte do Regulamento Geral sobre a Proteção de Dados (GDPR) europeu. A experiência com a lei, no entanto, indica que tais regras são difíceis de fiscalizar. De qualquer modo, os Estados Unidos não possuem um regime de proteção de privacidade comparável ao GDPR no nível nacional. Além disso, quando se trata do poder de gigantes da tecnologia, o estrago já está feito, por assim dizer: o Google e o Facebook já acumularam um volume imenso de dados sobre seus usuários, que não seriam afetados por restrições de privacidade limitando a coleta futura de dados.

………………

Middleware

Dada a inadequação dessas várias abordagens, é importante olhar mais atentamente para o remédio alternativo que o Grupo de Trabalho sobre a Escala das Plataformas Digitais da Universidade Stanford chamou de “middleware”. Middleware é um tipo de software que roda sobre uma plataforma e afeta a maneira pela qual os usuários interagem com os dados que trafegam por lá. Um middleware intermediário construído de maneira apropriada poderia, por exemplo, filtrar o conteúdo de uma plataforma não apenas adicionando marcadores, mas também eliminando itens considerados falsos ou enganosos, ou poderia certificar a confiabilidade de determinadas fontes de informação. Em um extremo, um middleware poderia assumir por completo a interface com o usuário de um Facebook ou um Google, relegando a essas plataformas o estado de meros provedores de conectividade de conteúdo (“dumb pipes”), que simplesmente transmitem os dados brutos, de maneira similar às empresas de telefonia. No outro extremo, um middleware poderia operar de maneira sutil, marcando conteúdos sem afetar decisões de curadoria sendo tomadas pelas plataformas. Isso se pareceria com os passos já tomados pelo Twitter para marcar certos tipos de conteúdo considerados enganosos, incluindo notícias sobre a corrida eleitoral norte-americana em novembro de 2020, mas permitiriam que usuários escolhessem a partir de um amplo menu de marcadores. Existem atualmente serviços de terceiros, como o NewsGuard, que são instalados em navegadores de internet e oferecem avaliação de usuários sobre a credibilidade das fontes de notícia. Um middleware poderia executar uma função similar, acoplando-se diretamente às plataformas de redes sociais, transformando o relacionamento entre os usuários e as plataformas de maneiras mais profundas.

Um middleware poderia reduzir o poder das plataformas tirando sua habilidade de curar conteúdo, transferindo essa função para uma ampla variedade de empresas que competem entre si, resultando em filtros que seriam personalizáveis pelos próprios usuários. Quando você abrisse uma conta no Facebook ou no Google, poderia escolher entre provedores de middleware que o permitiriam controlar suas buscas e seus feeds, da mesma maneira que hoje escolhe navegadores. No lugar de um algoritmo nada transparente embutido na plataforma, você poderia decidir usar um filtro oferecido por uma coalizão de universidades sem fins lucrativos que garantiria a confiabilidade das fontes de dados, ou um provedor que limitasse a exibição de produtos àqueles produzidos nos Estados Unidos, ou que fossem ambientalmente responsáveis.

Uma das objeções mais prováveis ao conceito de middleware é que ele simplesmente reforçaria as “bolhas de filtro” que já existem nessas plataformas. Ideólogos do “alt-right” e teóricos da conspiração poderiam construir filtros por conta própria que omitissem visões contrárias, levando a um aumento ainda maior da fragmentação do espaço político. Mas, como observado anteriormente, o objetivo da política não deveria ser o de suprimir conteúdo prejudicial. Este, exceto se incitar a violência, é constitucionalmente protegido. De qualquer modo, seria tecnologicamente bastante difícil de eliminar esse tipo de conteúdo. Após os ataques de 6 de janeiro ao Capitólio em Washington, D.C., os extremistas começaram a migrar para a nova plataforma Parler (que se vangloriava de sua moderação minimalista) e, depois, quando o Parler ficou temporariamente fora do ar após ser rejeitado pelo serviço de hospedagem da Amazon, para serviços de mensagens criptografadas como o Telegram ou o Signal.

Por mais que detestemos esse fato, o discurso de ódio e as teorias da conspiração são parte integrante da sociedade mais ampla, e um middleware não seria capaz de erradicá-los. Mas esse não é um objetivo apropriado de política pública em uma sociedade que valoriza a liberdade de expressão. O que um middleware poderia fazer, sim, é diluir dramaticamente o poder das plataformas de amplificar as visões extremistas e transformá-las na corrente dominante. Podemos pensar nisso usando a analogia de uma doença infecciosa: em vez de encorajar pessoas infectadas a confraternizarem com a sociedade em geral, deveríamos isolá-las em espaços compartilhados com outras pessoas já infectadas.

Um middleware não surgirá espontaneamente a partir das forças de mercado. Embora haja demanda por esse tipo de serviço, hoje ainda não há um modelo de negócio claro que o torne viável. Os proprietários das plataformas podem ficar felizes em se isentar da responsabilidade de tomar decisões politicamente controversas em relação à moderação de conteúdo. De fato, o próprio Jack Dorsey, do Twitter, sugeriu recentemente “dar às pessoas mais escolhas sobre qual algoritmo de relevância usar”, acrescentando: “Pode-se imaginar uma abordagem mais orientada ao mercado, com um marketplace de algoritmos”. Por outro lado, as grandes empresas de tecnologia não gostarão da perda de controle criada pela intermediação de um middleware. Isso significa que a criação de um setor de middleware vibrante e competitivo dependerá da regulamentação estatal, tanto para estabelecer regras para interfaces de programação de aplicações (API) por meio das quais as empresas se conectarão às plataformas, como para estabelecer regras de compartilhamento de receitas que garantam um modelo de negócio viável para fornecedores de middleware. São questões que precisam ser pensadas e trabalhadas em maior detalhe enquanto pensamos nas consequências da crise política que enfrentamos.

………..

Perspectivas

Mais e mais pessoas estão chegando à conclusão de que a tecnologia moderna criou um tipo de monstro, um sistema de comunicações que contorna instituições que costumavam estruturar o discurso democrático e oferecer uma base comum de conhecimento factual aos cidadãos com base na qual pudessem deliberar. As empresas privadas responsáveis por esse novo sistema estão atualmente entre as maiores empresas do mundo. Possuem não apenas uma enorme riqueza, que podem usar para defender seus interesses, mas também uma dominância sobre os canais de comunicação relevantes para a política democrática. Também se beneficiam de economias de escala que são inerentes a sistemas em rede, e não há uma maneira fácil de impedi-las de crescer ainda mais. A pandemia da Covid-19 que atingiu o planeta em 2020 aumentou enormemente seu poder e sua importância.

Até o momento, as grandes plataformas ainda não consideram que seja de seu interesse manipular deliberadamente os resultados eleitorais ou políticos. Seus interesses comerciais, no entanto, as têm motivado a privilegiar alguns tipos de conteúdo viral na maioria das vezes falso, conspiratórios ou prejudiciais à prática democrática. Em termos de saúde da democracia, deveríamos estar preocupados com o poder que essas plataformas possuem. São necessárias políticas públicas para reduzir esse poder que, caso contrário, pode cair nas mãos de pessoas que queiram manipular eleições de maneira deliberada.

O objetivo das políticas públicas não deveria ser o de controlar conteúdo. Democracias modernas renunciaram a tais controles quando se comprometeram com a proteção da liberdade de expressão. O que queremos, em vez disso, são políticas públicas que previnam atores políticos de usar seu poder para amplificar ou suprimir artificialmente certos tipos de conteúdo, e que mantenham um ambiente com igualdade de condições para que ideias possam competir entre si.

Embora grande parte da discussão aqui tenha focado nos Estados Unidos e na atual crise da democracia americana, o poder excessivo das plataformas traz repercussões globais. O Facebook e o Twitter são ainda mais politicamente importantes em países menores, onde se tornaram importantes canais para a comunicação pública e privada. Após a suspensão da conta de Donald Trump no Twitter, os críticos imediatamente perguntaram por que decisões similares não foram tomadas para restringir o comportamento antidemocrático de outros políticos ao redor do mundo, de populistas eleitos a governantes autocratas, que usaram retóricas incendiárias online. Na Índia, por exemplo, o Facebook foi alvo de críticas por não ter removido posts que fomentavam a violência contra os muçulmanos.

Está claro que essas gigantes empresas norte-americanas não possuem a capacidade de fazer julgamentos políticos nuançados sobre a aceitabilidade de cada conteúdo nos cerca de 150 países em que operam. É muito difícil enxergar o que lhes daria o incentivo para adquirir essa capacidade. Mais importante, elas não possuem a legitimidade para controlar conteúdo em seu país de origem, os Estados Unidos, muito menos em outros países mundo afora.

É por isso que a diminuição do poder das plataformas é fundamental para a sobrevivência da democracia ao redor do mundo. Embora os europeus tenham se esforçado em limitar o poder das plataformas, até o momento os norte-americanos têm sido complacentes sobre o problema. Agora que há um amplo consenso de que as grandes plataformas representam um perigo à democracia norte-americana, é vital entender precisamente onde reside o perigo, e quais são os remédios, ao mesmo tempo, política e tecnologicamente realistas.

………

………

………..